خوارزمية الوضع المتحرك

عرضنا النهائي من ديسمبر 2020

حول المشروع

كمشروعنا النهائي لدورة مقدمة في تعلم الآلة (CSCI470) في خريف 2020 في مدرسة كولورادو للمناجم، قام فريقنا، الذي يتكون من أندرو دارلينغ، إريك هايز، وأنا (محمد)، بتنفيذ خوارزمية “الوضع المتحرك”.

كان الهدف هو أخذ مجموعة بيانات هيكلية تم التقاطها بواسطة مستشعر عمق وتصنيف أفعال الإنسان. لم نقم فقط بتنفيذ الخوارزمية الأساسية ولكننا أيضًا طورنا واجهة مستخدم بسيطة لعرض قدراتها.

خوارزمية الوضع المتحرك، التي اقترحها في الأصل ميهاي زانفير، وماريوس ليوردينو، وكريستيان سمينشيسكو، هي طريقة قوية للتعرف على وفهم أفعال الإنسان بسرعة ودقة من بيانات هيكلية ثلاثية الأبعاد.

الورقة

تنفيذنا يعتمد على الورقة الوضع المتحرك: موصوف حركي ثلاثي الأبعاد فعال للتعرف على الأفعال والكشف عنها بوقت استجابة منخفض (PDF) بواسطة ميهاي زانفير، ماريوس ليوردينو، وكريستيان سمينشيسكو.

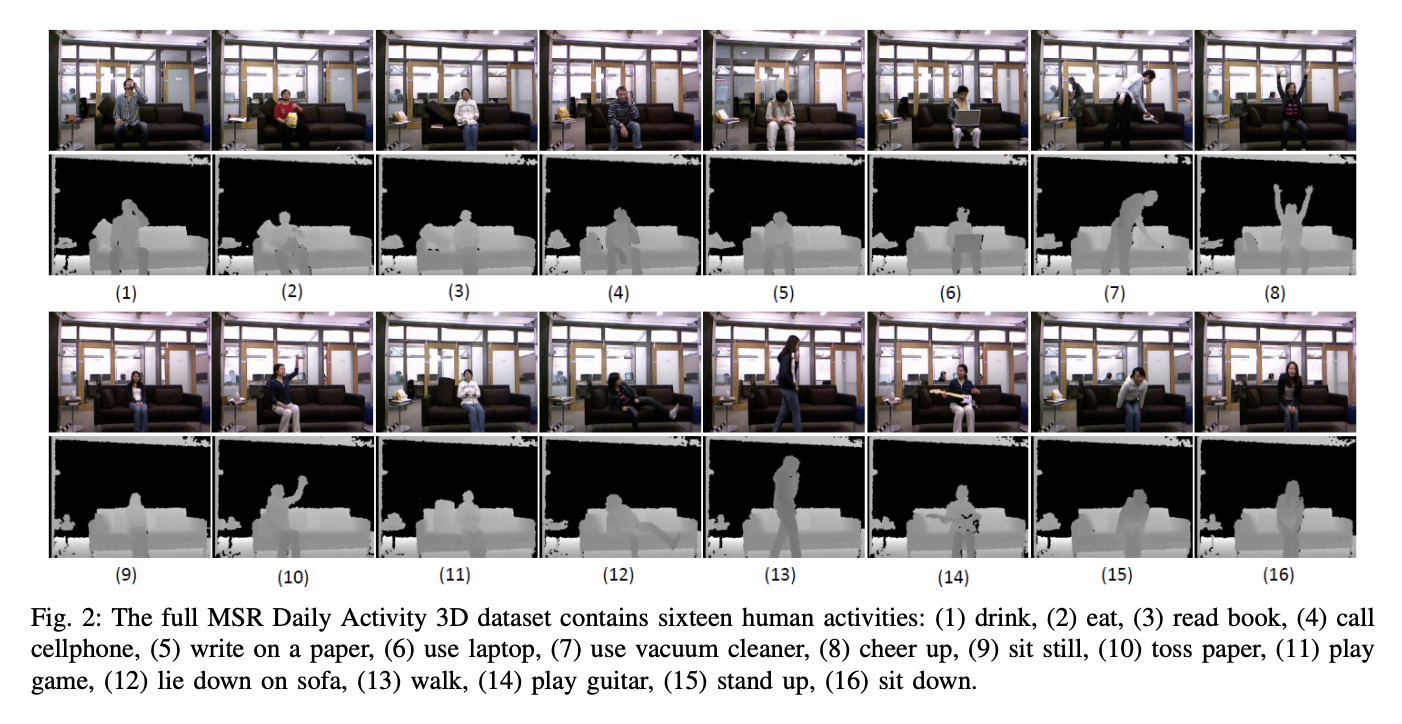

مجموعة البيانات

تم تدريب نموذجنا واختباره على مجموعة بيانات MSR DailyActivity 3D. ركزنا على الأفعال التالية من مجموعة البيانات:

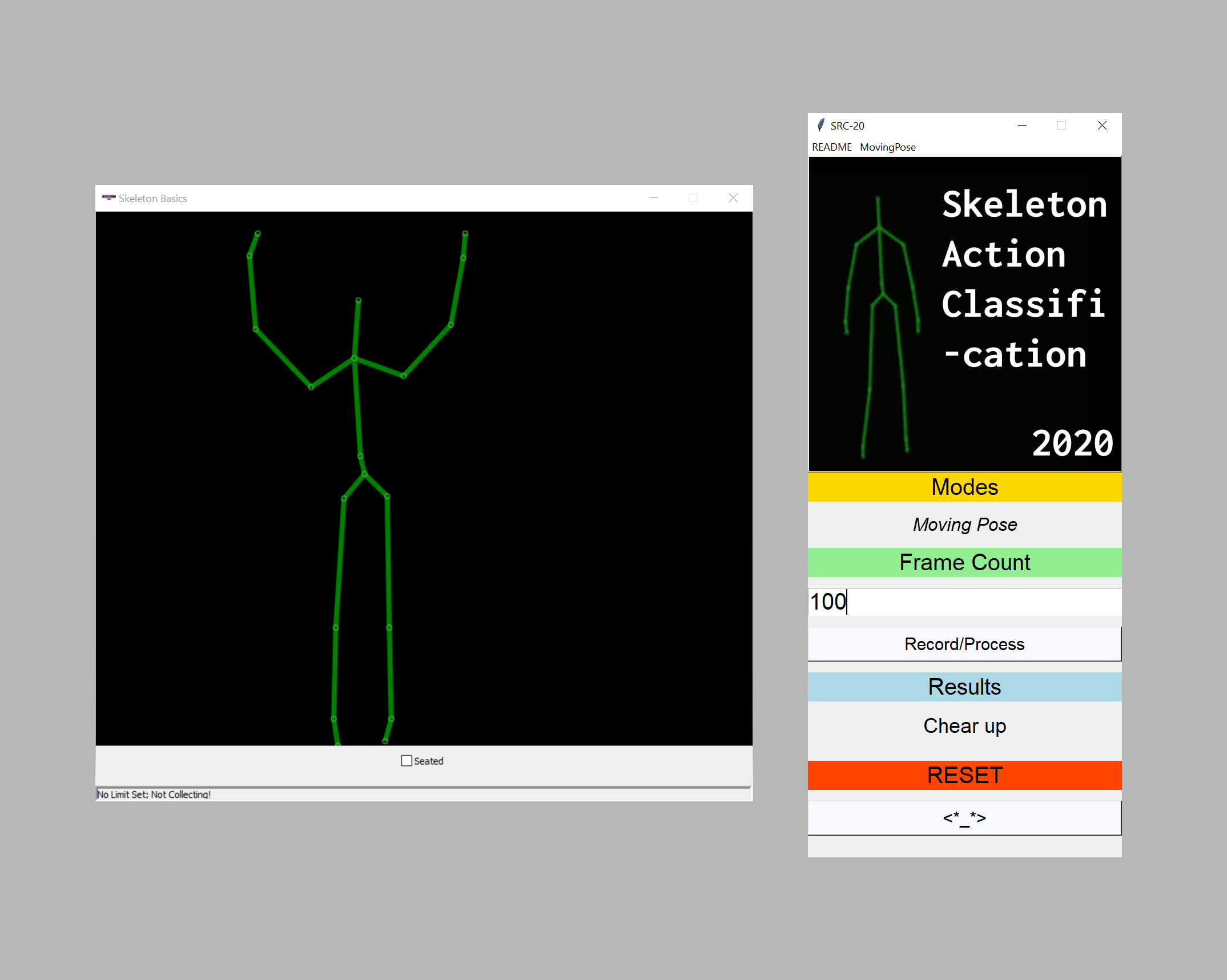

معاينة واجهة المستخدم

قمنا ببناء واجهة مستخدم بسيطة لتصور أداء الخوارزمية في الوقت الحقيقي. لمزيد من التفاصيل حول واجهة المستخدم والأجهزة المستخدمة، يرجى الاطلاع على ملف README.md في دليل /movingpose/gui/ من مستودع المشروع.